كان المهندس الذي يعمل في فيسبوك متشوقاً لمعرفة سبب عدم رد صديقته الحميمة على رسائله. ربما كان هناك تفسير بسيط، لعلها كانت مريضة أو في إجازة.

لذا، عند الساعة 10 مساءً في إحدى الليالي في مقر الشركة في مينلو بارك، دخل إلى ملفها الشخصي على فيسبوك عبر الأنظمة الداخلية للشركة، وبدأ يبحث في بياناتها الشخصية: توجهاتها السياسية ونمط حياتها واهتماماتها، وحتى موقعها في الوقت الفعلي.

تم طرد المهندس لاحقاً نتيجة لسلوكه هذا، بالإضافة إلى 51 موظفاً آخر أساؤوا بشكل غير لائق استغلال ميزة وصولهم إلى بيانات الشركة، وهو امتياز كان متاحاً في ذلك الحين لكل من عمل في فيسبوك بغض النظر عن وظيفتهم أو أقدميتهم. كانت الغالبية العظمى من الموظفين الـ 51 مثله تماماً؛ إذ كانوا رجالاً يبحثون عن معلومات حول النساء اللواتي أثرن اهتمامهم.

في سبتمبر من عام 2015 -بعد أن لفت أليكس ستاموس، كبير مسؤولي الأمن الجديد، انتباه مارك زوكربيرج إلى هذه المشكلة- أمر الرئيس التنفيذي بإصلاح شامل للنظام لتقييد وصول الموظفين إلى بيانات المستخدمين. كانت تلك الخطوة انتصاراً نادراً لستاموس؛ حيث نجح في إقناع زوكربيرج بأن المسؤولية عن هذا الخلل تكمن في تصميم فيسبوك نفسها وليس في السلوك الفردي.

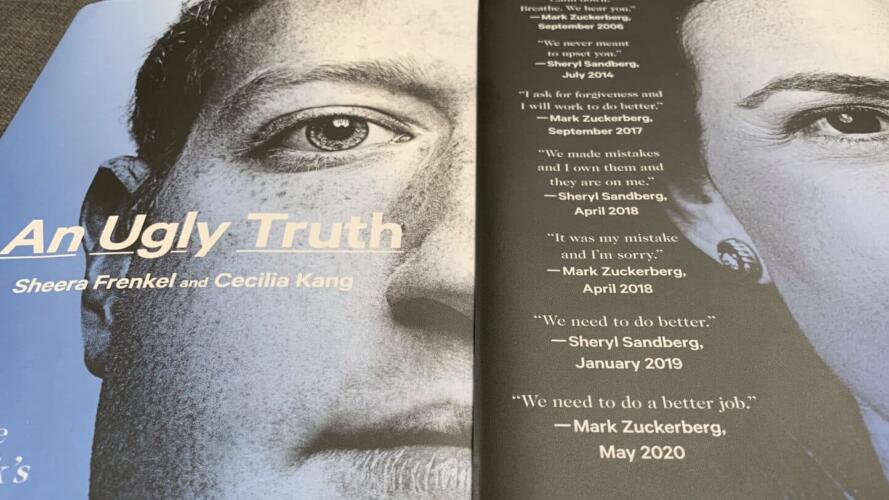

هكذا جاء في افتتاحية كتاب "الحقيقة المرّة"، وهو كتاب جديد عن فيسبوك كتبته مراسلتا صحيفة نيويورك تايمز المخضرمتان شيرا فرنكل وسيسيليا كانج. بفضل خبرة فرنكل في مجال الأمن السيبراني، وخبرة كانج في مجال التكنولوجيا والسياسة التنظيمية، ومصادرهما العميقة، يقدم الثنائي سرداً مقنعاً لسنوات فيسبوك التي تمتد بين انتخابات عامي 2016 و2020.

خلال تلك السنوات، لم يعد ستاموس محظوظاً إلى ذلك الحد؛ فالمشاكل الناجمة عن نموذج أعمال فيسبوك لم تزدد إلا سوءاً في السنوات التالية، ولكن عندما اكتشف ستاموس المزيد من المشاكل الفظيعة، بما في ذلك التدخل الروسي في الانتخابات الأميركية، اضطر لوضع زوكربيرج وشيريل ساندبرج في مواجهة مباشرة مع حقائق مزعجة. بمجرد مغادرته الشركة، استمرت قيادتها في رفض معالجة مجموعة كبيرة من المشاكل المقلقة للغاية بما في ذلك فضيحة كامبريدج أناليتيكا، والإبادة الجماعية في ميانمار، وتفشي المعلومات الخاطئة.

الصورة تقدمة من بيولف شيهان

تقول فرنكل وكانج إن مشاكل فيسبوك الحالية ليست نتاج شركة ضلت طريقها، بل تمثل جزءاً من تصميم الشركة في حد ذاتها، الذي بُني على أساس نظرة زوكربيرج الضيقة للعالم، والثقافة الطائشة التي رسمها بشأن الخصوصية، والطموحات المربكة التي سعى لتحقيقها مع ساندبرج.

ربما يمكن تبرير هذا الافتقار إلى البصيرة والخيال عندما كانت فيسبوك لا تزال شركة صغيرة، ولكن قرارات زوكربيرج وساندبرج أظهرت منذ ذلك الحين أن النمو والعوائد بالنسبة لهما يتمتعان بأهمية أكبر من كل شيء آخر.

وعلى سبيل المثال، في أحد فصول الكتاب الذي يحمل عنوان "الشركة أهم من البلد"، تسرد المؤلفتان كيف حاولت قيادة الشركة إخفاء مدى التدخل الروسي عبر منصتها في الانتخابات عن مجتمع الاستخبارات الأميركية والكونجرس والجمهور الأميركي. فقد قامت القيادة بفرض رقابة على المحاولات المتعددة لفريق أمان فيسبوك لنشر تفاصيل ما وجدوه، وانتقوا البيانات بعناية للتقليل من خطورة المشكلة وطبيعتها الحزبية. عندما اقترح ستاموس إعادة تصميم هيكلية الشركة لمنع تكرار المشكلة، رفض القادة الآخرون الفكرة ووصفوها بأنها "مثيرة للقلق" وركزوا مواردهم على ضبط السرد العام وكبح الجهات التنظيمية.

في عام 2014، بدأ نمط مماثل في التبلور لدى استجابة فيسبوك لتصاعد العنف في ميانمار، وقد تم تناولها بالتفصيل في الفصل المعنون "فكر قبل أن تشارك". قبل ذلك بعام، شرع النشطاء المقيمون في ميانمار بالفعل بتحذير الشركة بشأن المستويات المقلقة التي بلغها خطاب الكراهية والمعلومات المضللة على المنصة والموجهة ضد أقلية الروهينجا المسلمة في البلاد. ولكن فيسبوك لم تأخذ تلك التحذيرات على محمل الجد لأنها كانت منهمكة بتحقيق رغبة زوكربيرج في التوسع عالمياً.

عندما اندلعت أعمال الشغب في البلاد، تجلت من جديد أولويات الشركة؛ حيث التزمت الصمت عند مقتل شخصين وإصابة 14 آخرين، لكنها خرجت عن صمتها في اللحظة التي منعت فيها الحكومة البورمية الوصول إلى فيسبوك في البلاد. ثم استمرت القيادة في تأخير الاستثمارات والتغييرات في المنصة -التي كان من شأنها أن تمنع تفاقم العنف- لأن تلك الخطوات قد تخاطر بتقليل تفاعلات المستخدمين مع المنصة. وبحلول عام 2017، تحولت التوترات العرقية إلى إبادة جماعية شاملة، التي وجدت الأمم المتحدة لاحقاً أن فيسبوك "ساهمت فيها بشكل جوهري"؛ ما أدى إلى مقتل أكثر من 24,000 من مسلمي الروهينجا.

هذا ما تسميه فرنكل وكانج بـ "حقيقة فيسبوك المرّة"؛ إنها حالة "انفصام متضارب" تتمثل في الرغبة في توفير التواصل بين الناس من أجل النهوض بالمجتمع ولكن أيضاً الاهتمام بشكل أساسي بالربح والنمو. يوضح الكتاب فصلاً تلو الآخر بجلاء أنه لا يمكن تحقيق كلتا الرغبتين، وقد اختارت فيسبوك -مرة أخرى- الرغبة الأخيرة المتمثلة في الربح على حساب الرغبة الأولى.

يعد الكتاب عملاً فذاً من حيث أسلوبه في سرد القصص وطريقة نقله للحقائق في آن معاً. وسواء كنت قد تابعت فضائح فيسبوك عن كثب كما تابعتها أنا، أو كنت قد سمعت أجزاء ومقتطفات حولها دون متابعة حثيثة، فإن فرنكل وكانج قد صاغتا الكتاب بطريقة تحمل فائدة ومتعة للجميع. تنقل الحكايات التفصيلية القراء إلى وراء الكواليس داخل غرفة اجتماعات زوكربيرج المعروفة باسم "أكواريوم"، حيث رسمت قرارات مصيرية مسار الشركة. وتم تقديم كل فصل بأسلوب يضمن أن تقرأ معلومات جديدة في كل صفحة من صفحاته.

ورغم أنني كنت على اطلاع على كل الأحداث التي أشارت إليها المؤلفتان، إلا أنني اكتشفت أن الشركة قد سعت إلى حماية نفسها على حساب الآخرين لدرجة أسوأ مما كنت أعرفه سابقاً. في هذه الأثناء، كان شريكي الذي قرأ الكتاب معي -والذي يندرج ضمن الفئة الثانية من القراء- يرفع رأسه مراراً ناظراً إلي مندهشاً مما يقرؤه ويكتشفه.

تقدم المؤلفتان تحليلهما الخاص في حدوده الدنيا، مفضلتين ترك الحقائق تتحدث عن نفسها. وبهذه الروح، فإنهما في نهاية سردهما تترفعان عن تقديم أي استنتاجات حاسمة حول ما يجب فعله مع فيسبوك أو ما تمليه علينا المعلومات التي تقدمانها. وتكتبان: "حتى لو خضعت الشركة لتحول جذري في العام المقبل، فمن غير المرجح أن يأتي هذا التغيير من الداخل". ولكن عندما نقرأ ما بين السطور، تتجلى الرسالة واضحة لا لبس فيها: فيسبوك لن تصلح نفسها أبداً.