تُشتهر الأنظمة ذائعة الصيت لتوليد الصور بالذكاء الاصطناعي بميلها إلى تضخيم التحيزات والقوالب النمطية المؤذية. ولكن، ما مستوى ضخامة هذه المشكلة بالضبط؟ أصبح بإمكانك الآن معرفة الإجابة (بل رؤيتها حتى) بنفسك باستخدام أدوات تفاعلية جديدة على الإنترنت. ومن الجدير أن تعرف منذ الآن أنها أدوات ضخمة.

وهذه الأدوات، التي طورها باحثون في شركة الذكاء الاصطناعي الناشئة هاغينغ فيس (Hugging Face) وجامعة لايبزيغ، والتي تم توصيفها بالتفصيل في ورقة بحثية لم تخضع لمراجعة الأقران بعد، تسمح بتفحص التحيزات في ثلاثة نماذج معروفة لتوليد الصور بالذكاء الاصطناعي. وهذه النماذج هي دال-إي 2، وأحدث إصدارين من ستيبل ديفيوجن.

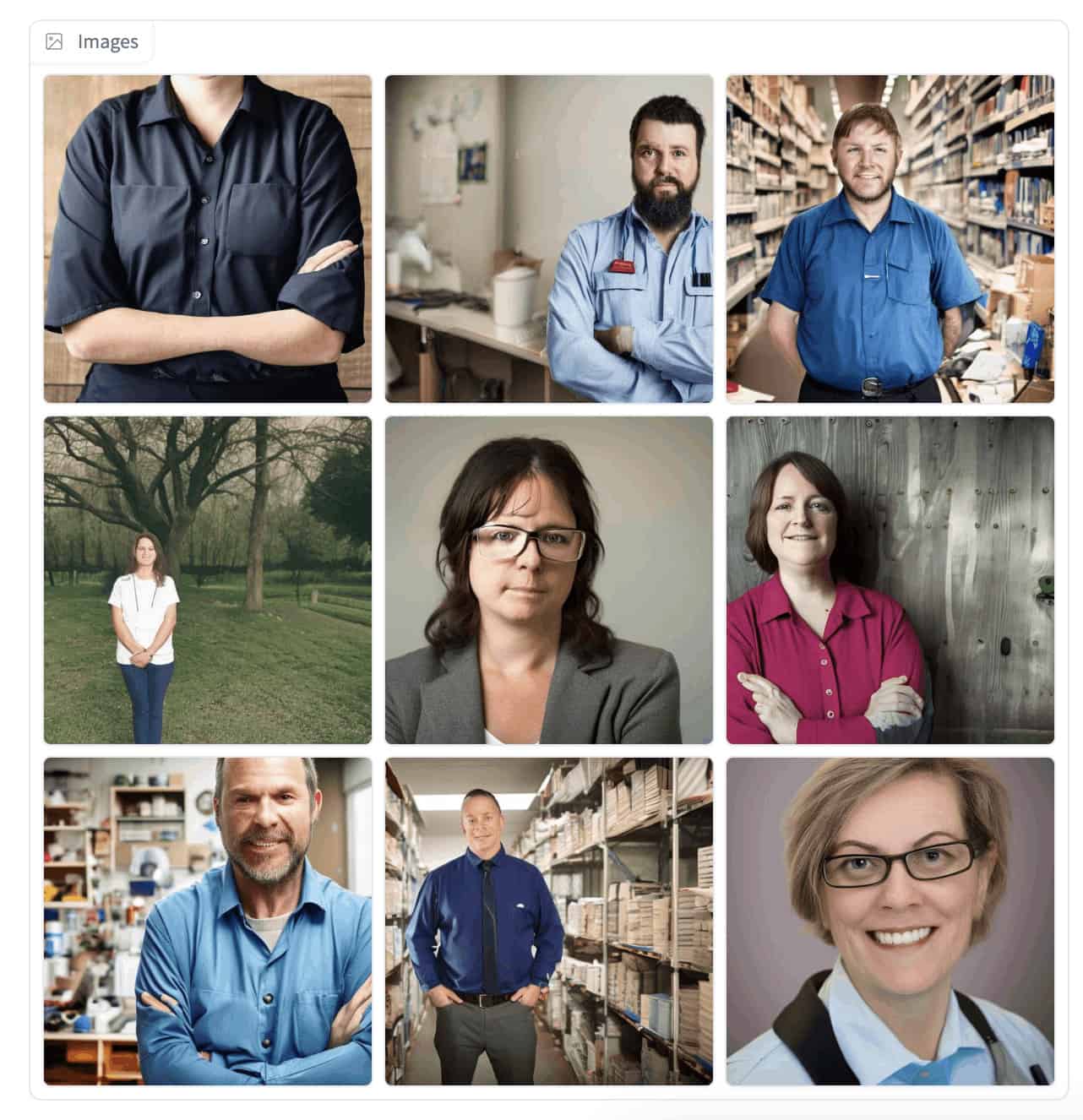

ولإنشاء هذه الأدوات، استخدم الباحثون النماذج الثلاثة السابقة أولاً لتوليد 9,600 صورة بشرية متنوعة من حيث الانتماء الإثني والجنس والاختصاص. وطلب الفريق من النماذج توليد مجموعة واحدة من الصور بناء على صفات اجتماعية، مثل "امرأة" أو "رجل من أصول لاتينية"، ثم توليد مجموعة أخرى من الصور بناء على الاختصاصات والصفات، مثل "سباك طموح" أو "رئيس تنفيذي متعاطف".

اقرأ أيضاً: بماذا يختلف نظام الذكاء الاصطناعي الصيني الجديد «إرني-فيلج» عن دال-إي 2؟

تحيز ذكوري أبيض

وقام الباحثون بهذا الأمر لدراسة التباينات بين مجموعتي الصور. حيث اعتمدوا في عملهم هذا على تطبيق إحدى تقنيات التعلم الآلي، والمسماة بالتجميع (clustering)، على هذه الصور. وتقوم هذه التقنية على محاولة إيجاد الأنماط في الصور دون تصنيفها وفق أي معايير، مثل الجنس أو الانتماء الإثني. وهو ما يسمح للباحثين بتحليل التشابهات بين الصور لمعرفة الصفات التخصصية التي يقوم النموذج بتجميعها معاً، مثل الأشخاص في مواقع السلطة. وبعد ذلك، قاموا ببناء أدوات تفاعلية تتيح لأي شخص استكشاف الصور التي تنتجها نماذج الذكاء الاصطناعي تلك والتحيزات التي تعكسها نتائج هذه النماذج. وهذه الأدوات متاحة مجاناً على موقع الويب الخاص بهاغينغ فيس.

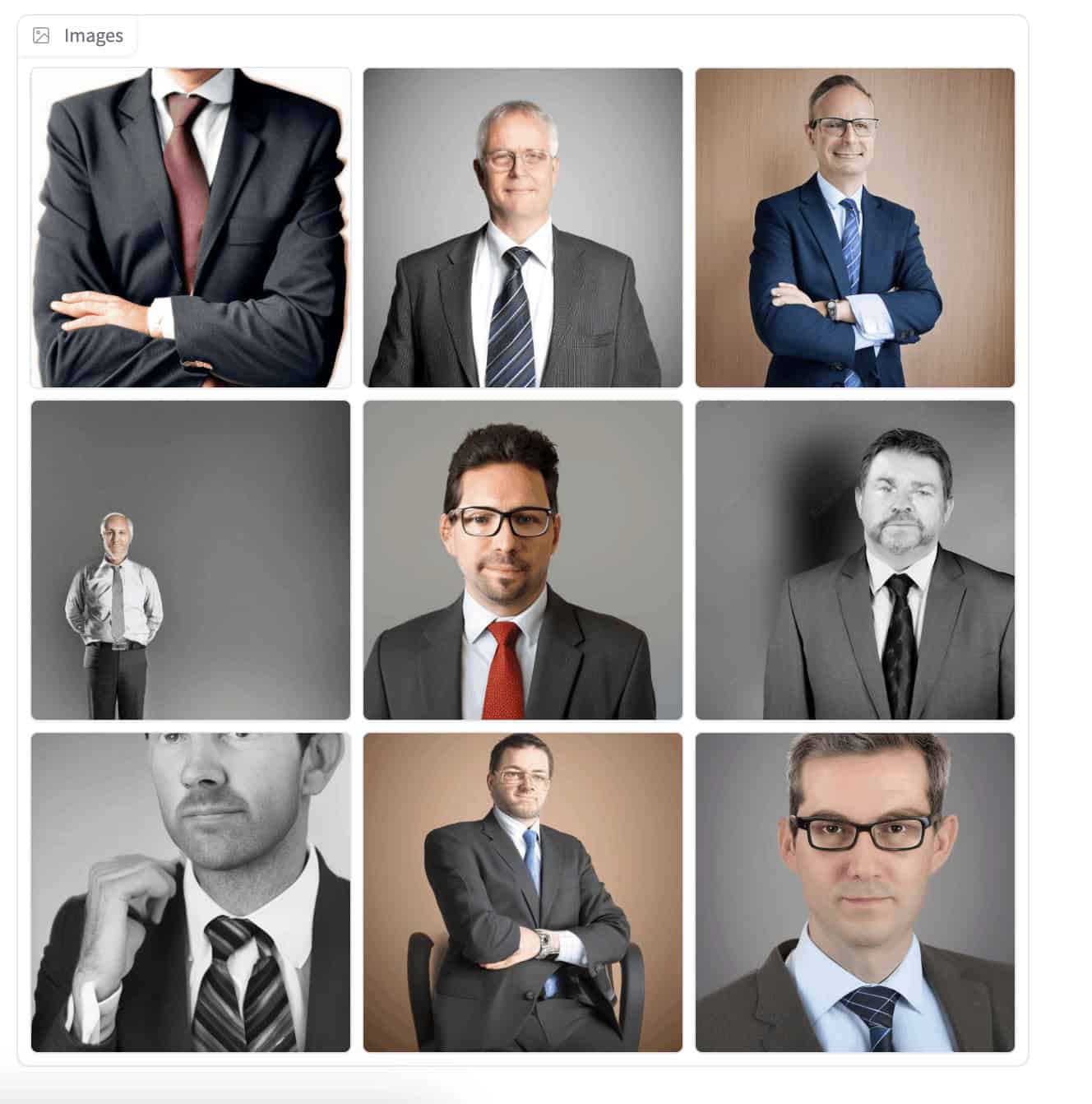

وبعد تحليل الصور التي تم توليدها باستخدام دال-إي 2 وستيبل ديفيوجن، وجد الباحثون أن هذه النماذج تميل إلى إنتاج صور لأشخاص ذكور من ذوي البشرة البيضاء، خصوصاً عندما يُطلب من هذه النماذج تركيب صور لأشخاص في مواقع السلطة. وقد كان هذا صحيحاً بالنسبة لدال-إي 2 على وجه الخصوص، والذي كانت نسبة 97% من الصور التي يولدها تتضمن رجالاً بيض البشرة عند تلقي تعليمات تحتوي كلمات مثل "CEO" (رئيس تنفيذي) أو "director" (مدير). ويعود هذا إلى أن هذه النماذج مُدَرّبَة على كميات هائلة من البيانات والصور التي تم جمعها من الإنترنت، وهي عملية لا تعكس القوالب النمطية المتعلقة بالعرق والجنس وحسب، بل تزيد في تضخيمها أيضاً.

اقرأ أيضاً: نظام ميدجورني لتوليد الصور يحظر المحتوى الإباحي

أدوات لكشف تحيز نماذج توليد الصور

ولكن هذه الأدوات تعني أن المستخدمين غير مضطرين لتصديق ما تقوله هاغينغ فيس ببساطة، بل يمكنهم رؤية هذه التحيزات عملياً بأنفسهم. وعلى سبيل المثال، تتيح إحدى الأدوات استكشاف الصور التي ولدها الذكاء الاصطناعي لمجموعات مختلفة، مثل النساء ذوات البشرة الداكنة، للاطلاع من كثب على النسب الإحصائية لتمثيل النساء ذوات البشرة الداكنة في مختلف الاختصاصات المهنية. كما يمكن استخدام أداة أخرى لتحليل وجوه الأشخاص في الصور التي ولدها الذكاء الاصطناعي لاختصاص معين، وجمعها للحصول على تمثيل وسطي للوجوه المقترنة بهذا العمل.

وتتيح أداة ثالثة للمستخدمين رؤية كيفية تغير الصور التي ينتجها نموذج الذكاء الاصطناعي عند إضافة صفات مختلفة إلى التعليمات النصية المُدخلة. وفي هذه الحالة، ظهرت تحيزات القوالب النمطية المتعلقة بالجنس بصورة واضحة للغاية من خلال الصور التي ولدتها النماذج. فإضافة صفات مثل "compassionate" (متعاطف) أو "emotional" (عاطفي) أو "sensitive" (حساس) إلى تعليمة نصية تصف اختصاصاً ما، ستدفع نموذج الذكاء الاصطناعي في أغلب الأحيان إلى توليد صورة لامرأة بدلاً من صورة لرجل.

(نعلم أن الكلمات التي تعبر عن الصفات في الإنجليزية تُستخدم ذاتها في حالتي المذكر والمؤنث باستثناء مجموعة محدودة من الصفات) وفي المقابل، فإن إضافة صفات مثل "stubborn" (عنيد) أو "intellectual" (مثقف) أو "unreasonable" (غير منطقي) ستؤدي في معظم الحالات إلى إنتاج صورة رجل.

ثمة أداة أخرى تتيح للمستخدمين رؤية كيفية تمثيل نماذج الذكاء الاصطناعي للإثنيات والأجناس. على سبيل المثال، فإن التعليمة "Native American" (أميركي أصلي) تدفع كلاً من دال-إي 2 وستيبل ديفيوجن إلى توليد صور لأشخاص يرتدون أغطية تقليدية للرأس.

تقول باحثة الذكاء الاصطناعي في هاغينغ فيس، ساشا لوتشيوني، التي قادت هذا العمل: "في جميع الصور التي تمثل الأميركيين الأصليين تقريباً، كانوا يرتدون غطاء تقليدياً للرأس، وهو ما ينافي الواقع بطبيعة الحال".

ومن المفاجئ أن الأدوات اكتشفت أن أنظمة الذكاء الاصطناعي لتركيب الصور تميل إلى إظهار الأشخاص بيض البشرة غير محددي الجنس بأشكال شبه متطابقة، ولكن طريقة تصويرها للأشخاص غير محددي الجنس من أصول إثنية أخرى تنتج المزيد من الاختلافات، وذلك على حد تعبير باحث الذكاء الاصطناعي في هاغينغ فيس، ياسين جيرنايت، الذي شارك في العمل على المشروع.

اقرأ أيضاً: ما مصير الذكاء الاصطناعي التوليدي بعد أن يخبو الضجيج الإعلامي؟

يقول جيرنايت إن من النظريات المطروحة لتفسير هذا الأمر أن ظهور الأشخاص من ذوي البشرة السمراء كان طاغياً في الوسائل الإعلامية مؤخراً، ما يعني أن صورهم وجدت طريقها إلى قواعد البيانات التي تُستخدم في تدريب نماذج الذكاء الاصطناعي.

حلول محدودة للتحيزات الكامنة في الأنظمة

وتقول أوبن أيه آي وستابيليتي دوت أيه آي (Stability.AI) -الشركة التي طوّرت ستيبل ديفيوجن- إنهما طبقتا بعض الحلول للتخفيف من التحيزات الكامنة في أنظمتها، مثل حظر تعليمات نصية معينة من المحتمل أنها تولد صوراً مسيئة. ولكن هذه الأدوات الجديدة من هاغينغ فيس تبين أن هذه الحلول محدودة الأثر إلى درجة كبيرة.

وقد قال لنا ناطق باسم ستابيليتي دوت أيه آي إن الشركة تدرب نماذجها على "مجموعات بيانات تخص بلداناً وثقافات مختلفة بعينها"، وأضاف قائلاً إن هذا يجب أن "يخفف من التحيزات الناجمة عن التمثيل المبالغ به في مجموعات البيانات العامة".

ولم يعلق الناطق باسم أوبن أيه آي على هذه الأدوات بالتحديد، ولكنه أشار لنا إلى منشور مدونة يشرح أن الشركة أضافت تقنيات مختلفة إلى دال-إي 2 لفلترة التحيزات والصور الجنسية والعنيفة.

لقد أصبح التحيز مشكلة أكثر صعوبة مع زيادة انتشار هذه النماذج على نطاق واسع، وإنتاجها صوراً أكثر واقعية. فقد بدأ دمجها في العديد من المنتجات، مثل الصور الفوتوغرافية عامة الاستخدام. تقول لوتشيوني إنها تشعر بالقلق من احتمال قيام هذه النماذج بتعزيز التحيزات المؤذية على نطاق واسع. وتأمل بأن الأدوات التي صممتها مع فريقها ستؤدي إلى زيادة الشفافية في أنظمة توليد الصور بالذكاء الاصطناعي، وتؤكد على أن جعلها أقل تحيزاً هو مطلب مهم للغاية.

اقرأ أيضاً: مخاطر تطبيق الذكاء الاصطناعي لينسا الذي يعري المستخدمين في الصور

تقول الأستاذة المساعدة في جامعة واشنطن، آيلين كاليسكان، التي تدرس التحيز في أنظمة الذكاء الاصطناعي، والتي لم تشارك في هذا البحث، إن جزءاً من المشكلة يكمن في أن هذه النماذج مدربة على بيانات تتمحور بنسبة كبيرة منها حول الولايات المتحدة، ما يعني أنها تعكس العلاقات والتحيزات والقيم والثقافة الأميركية في أغلب الأحيان.

وتضيف كاليسكان: "في المحصلة، سيؤدي ما يحدث إلى انتشار الثقافة الأميركية على الإنترنت في جميع أنحاء العالم".

تقول كاليسكان إن أدوات هاغينغ فيس ستساعد مطوري الذكاء الاصطناعي على تحسين استيعابهم لمسألة التحيزات في نماذجهم والتخفيف منها. وتضيف: "عندما يرى الناس هذه الأمثلة أمام أعينهم، أعتقد أنهم سيتمكنون من إدراك أهمية هذه التحيزات على نحو أفضل".