يقول الخبر

في التقرير الأخير لفيسبوك المتعلق بتطبيق المعايير المجتمعية، والذي صدر في 12 مايو، قامت الشركة بتفصيل التحديثات التي أجرتها على أنظمة الذكاء الاصطناعي الخاصة بها للكشف عن الخطاب المحرض على الكراهية والمعلومات المضللة؛ حيث تقول الشركة العملاقة في مجال التكنولوجيا إن 88.8% من مجمل المحتوى المحرض على الكراهية الذي قامت بحذفه خلال هذا الربع من العام، قد تم كشفه بواسطة الذكاء الاصطناعي، في حين بلغت في الربع السابق 80.2%. فالذكاء الاصطناعي قادر على حذف المحتوى بشكل تلقائي، إذا كان لدى النظام درجة عالية من الثقة بوجود كلام يحرض على الكراهية. إلا أن التحقق من الجزء الأكبر من هذا المحتوى لا يزال يجري بالاعتماد على الجهد البشري أولاً.

ما وراء الكواليس

يرجع التحسن في كشف هذا النوع من المحتوى إلى اثنين من الجوانب المستجدة التي طرأت على أنظمة الذكاء الاصطناعي لدى فيسبوك. أولاً، تستخدم الشركة في الوقت الحالي نماذج ضخمة للغات الطبيعية يمكنها تحليل المعاني والتفاصيل الصغيرة التي تحملها المنشورات. وتعتمد هذه النماذج على ما تم إحرازه من تقدم في أبحاث الذكاء الاصطناعي على مدى العامين الماضيين، والذي سمح بتدريب الشبكات العصبونية على اللغات دون الحاجة إلى أي نوع من الإشراف البشري، وهو ما أدى إلى تجاوز المعوقات الناجمة عن الإدارة اليدوية للبيانات.

أما الأمر الثاني المستجد، فهو أن أنظمة فيسبوك باتت قادرة الآن على تحليل المحتوى الذي يجمع بين النص والصور في الوقت نفسه، الميمات الداعية إلى الكراهية. ما تزال قدرات الذكاء الاصطناعي محدودة في تفسير مثل هذا المحتوى المختلط من الوسائط، لكن فيسبوك قامت أيضاً بإصدار مجموعة جديدة من البيانات الخاصة بالميمات الداعية للكراهية، وأطلقت مسابقة تساعد على الاستعانة بجهود عامة الناس لابتكار خوارزميات أفضل للكشف عن هذا النوع من المحتوى.

الأكاذيب المحيطة بكوفيد

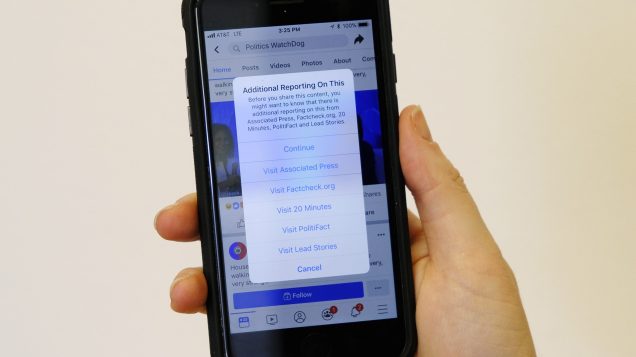

على الرغم من هذه المستجدات، إلا أن الذكاء الاصطناعي لم يلعب دوراً كبيراً في التعامل مع موجة المعلومات المضللة الخاصة بفيروس كورونا التاجي، مثل نظريات المؤامرة التي يتم طرحها حول منشأ الفيروس، والأخبار الزائفة عن وجود علاجات له. ولذلك، فقد اعتمدت فيسبوك بشكل رئيسي على مراجعين من البشر يعملون في أكثر من 60 مؤسسة ومنظمة شريكة متخصصة في كشف الحقائق. وقد اقتصر الأمر فقط على أنه عندما يقوم أحد الأشخاص المعنيين بتصنيف شيء ما، مثل صورة مرفقة بعنوان مضلل، عندها فقط تتولى أنظمة الذكاء الاصطناعي مهمة البحث عن عناصر مطابقة أو مشابهة له، وإضافة وسوم تحذيرية لها، أو إزالتها نهائياً. لم يتمكن الفريق بعد من تدريب نموذج تعلم آلي للعثور على حالات جديدة من المعلومات المضللة في حد ذاتها. وقد قال مايك شروبفر، رئيس قسم التكنولوجيا في فيسبوك في مكالمة صحافية: "إن بناء آلية جديدة للتصنيف لكي يعتمد عليها نظام قادر على فهم المحتوى يعد أمراً غير مسبوق، ويتطلب الكثير من الوقت والبيانات".

ما أهمية هذا التحدي؟

يكشف هذا التحدي أوجه القصور التي يعاني منها الإشراف على المحتوى بالاعتماد على الذكاء الاصطناعي. ويمكن لهذا النوع من الأنظمة أن يكشف محتوى مشابهاً لما تعاملوا معه من قبل، لكنها تتعثر عندما تظهر أنواع جديدة من المعلومات المضللة. في السنوات الأخيرة، استثمرت فيسبوك بشكل كبير في أنظمة الذكاء الاصطناعي القادرة على التكيف بوتيرة متسارعة، لكن المشكلة لا تخص فيسبوك وحدها، فهي تبقى واحدة من أكبر التحديات البحثية في مجال الذكاء الاصطناعي.