هل تتذكّر الصور الشخصية التي نشرتها؟ لا يوجد حالياً ما يمنع أي شخص من تحميلها وتعديلها باستخدام أنظمة الذكاء الاصطناعي التوليدية ذات الإمكانات الهائلة. والأسوأ من ذلك، قد يكون إثبات أن الصورة الناتجة عن عملية التعديل هذه مزيفة مستحيلاً بفضل تطوّر هذه الأنظمة.

لكن الخبر السار هو أن الباحثين في معهد ماساتشوستس للتكنولوجيا طوّروا أداة جديدة يمكن أن تقي من ذلك.

فوتو غارد : أداة لمنع التلاعب بالصور(PhotoGuard)

تؤدي هذه الأداة التي تحمل اسم فوتو غارد (PhotoGuard) دور درع واقٍ من خلال إجراء تعديلات بسيطة وغير مرئية للعين البشرية على الصور، ولكنها تمنع التلاعب بها. إذا حاول أحد استخدام تطبيق تعديل يعتمد على أحد نماذج الذكاء الاصطناعي التوليدية، مثل ستيبل ديفيوجن (Stable Diffusion)، للتلاعب بصورة "محمية" بهذه الأداة، فستبدو الصور المعدّلة غير واقعية أو مشوهة.

يقول الباحث في مرحلة الدكتوراة في معهد ماساتشوستس للتكنولوجيا، هادي سلمان، الذي أسهم في تطوير الأداة الجديدة، إنه حالياً "يمكن لأي شخص التقاط صور للآخرين وتعديلها كما يشاء، ووضعهم في مواقف سيئة للغاية وابتزازهم". قُدّمت الأداة الجديدة في المؤتمر الدولي للتعلم الآلي الذي أقيم في أواخر شهر يوليو/ تموز 2023.

قال سلمان إن أداة فوتو غارد هي "محاولة لحل مشكلة التلاعب بالصور على نحو ضار باستخدام نماذج الذكاء الاصطناعي". على سبيل المثال، يمكن استخدام الأداة الجديدة لمنع تحويل صور النساء الشخصية إلى مواد إباحية مزيّفة دون موافقتهن.

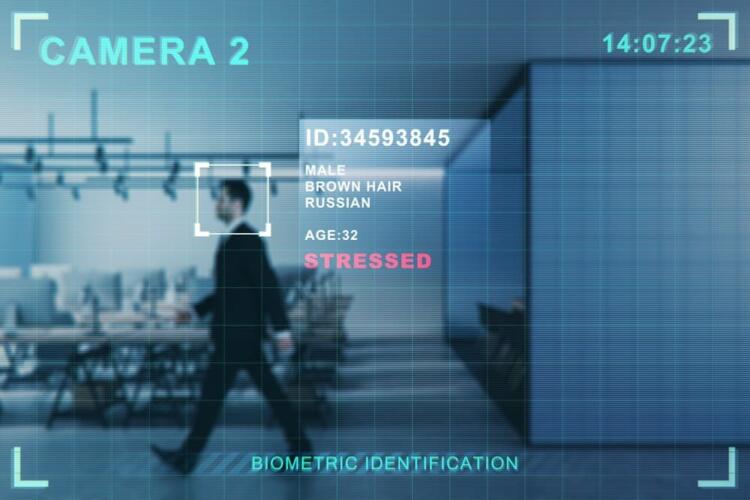

لم تكن الحاجة إلى إيجاد طرق لكشف التلاعب المدعوم بالذكاء الاصطناعي ومنعه ملحّة كما هي اليوم، وذلك لأن أدوات الذكاء الاصطناعي التوليدية جعلت هذا التلاعب أسرع وأسهل من أي وقت مضى. التزمت شركات الذكاء الاصطناعي الرائدة مثل أوبن أيه آي وجوجل وميتا من خلال تعهّد طوعي مع البيت الأبيض بتطوير مثل هذه الأساليب في محاولة لمنع الاحتيال والخداع. أداة فوتو غارد هي تقنية تكميلية لتقنية أخرى هي الوسم بالعلامات المائية؛ إذ تهدف الأولى إلى منع استخدام أدوات الذكاء الاصطناعي من التلاعب بالصور، بينما يعتمد الوسم بالعلامات المائية على استخدام إشارات غير مرئية مماثلة تتيح للأشخاص اكتشاف المحتوى الذي أنشأه الذكاء الاصطناعي بمجرد إنشائه.

اقرأ أيضاً: 7 طرق للكشف عن الصور المولّدة بالذكاء الاصطناعي

ما الآليات المستخدمة لمنع التلاعب بالصور؟

استخدم فريق معهد ماساتشوستس للتكنولوجيا طريقتين مختلفتين لمنع تعديل الصور باستخدام نموذج توليد الصور المفتوح المصدر، ستيبل ديفيوجن.

تحمل الطريقة الأولى اسم هجوم المُرمِّز؛ حيث تضيف أداة فوتو غارد إشارات لا يمكن إدراكها إلى الصور، يفسّرها نموذج الذكاء الاصطناعي على أنها أشياء أخرى. على سبيل المثال، يمكن أن تدفع هذه الإشارات نموذج الذكاء الاصطناعي إلى تصنيف صورة لمقدّم البرامج، تريفر نواه، على أنها كتلة من اللون الرمادي الصافي، ونتيجة لذلك فإن أي محاولة لاستخدام نموذج ستيبل ديفيوجن لتعديل الصورة ستبدو نتائجها غير مقنعة.

الآلية الثانية الأكثر فعالية هي هجوم البعثرة، تُعطّل هذه الآلية طريقة توليد نماذج الذكاء الاصطناعي للصور من خلال ترميزها بإشارات سرية تغيّر طريقة معالجة النماذج لها. استطاع الفريق، من خلال إضافة هذه الإشارات إلى صورة نواه، التلاعب بنموذج ستيبل ديفيوجن ودفعه لتجاهل الأمر النصيّ وتوليد الصورة التي أرادها الباحثون. بالنتيجة، ستظهر أي صورة لنواه رمادية اللون إذا أُجري عليها تعديل باستخدام الذكاء الاصطناعي.

يقول أستاذ علوم الكمبيوتر في جامعة شيكاغو، بن جاو، الذي طور طريقة وقائية مشابهة تحمل اسم غليز (Glaze) يمكن للفنانين استخدامها لمنع نماذج الذكاء الاصطناعي من استخدام أعمالهم، إن الأداة الجديدة "نتجت عن الحاجة الملموسة لتطوير طريقة فعالة والإمكانات الحالية".

تقول عالمة الأبحاث في شركة ميتا، إميلي وينغر، التي عملت أيضاً على تطوير أداة غليز وطوّرت طرقاً للوقاية من تكنولوجيا التعرّف على الوجه، إن الأدوات مثل فوتو غارد تغيّر الاعتبارات الاقتصادية لدى المهاجمين وما يحفزهم؛ لأنها تصعّب استخدام الذكاء الاصطناعي بطرق ضارة.

تضيف وينغر قائلة: "كلما زادت العقبات، قل عدد من يرغبون في تجاوزها أو يقدرون عليه".

اقرأ أيضاً: نظام ميدجورني لتوليد الصور يحظر المحتوى الإباحي

تحديات استخدام فوتو غارد

يقول جاو إن التحدي يتمثل في تطبيق التقنية الجديدة على نماذج الذكاء الاصطناعي الأخرى، إذ أصدر الباحثون نسخة تجريبية من الأداة على الإنترنت تسمح للأشخاص بحماية صورهم، لكنها تعمل حالياً بكفاءة على نموذج ستيبل ديفيوجن فقط.

تقول الباحثة في مرحلة الدكتوراة في جامعة ميريلاند، فاليريا شيريبانوفا، التي طوّرت تقنيات لحماية مستخدمي مواقع التواصل الاجتماعي من تكنولوجيا التعرّف على الوجه، إنه على الرغم من أن أداة فوتو غارد تجعل التلاعب بالصور الجديدة صعباً، فهي لا توفر حماية تامّة ضد تكنولوجيا التزييف العميق، لأن الصور القديمة للمستخدمين قد تبقى متاحة وتمكن إساءة استخدامها، كما أن هناك أكثر من طريقة لإنتاج الصور المزيفة.

ويقول الأستاذ في معهد ماساتشوستس للتكنولوجيا الذي أسهم في تطوير أداة فوتو غارد، ألكساندر مادري، إنه نظرياً يمكن للناس استخدام هذه الأداة لحماية صورهم قبل تحميلها على الإنترنت، لكنه يضيف إن النهج الأكثر فعالية هو أن تطبّقها شركات التكنولوجيا على الصور التي يحمّلها الناس على منصاتها تلقائياً.

اقرأ أيضاً: مخاطر تطبيق الذكاء الاصطناعي لينسا الذي يعري المستخدمين في الصور

سباق تسلح

مع ذلك، هذه المسألة هي بمثابة سباق تسلّح؛ إذ إنه على الرغم من تعهّد هذه الشركات بتحسين أساليب الحماية، فهي تعمل أيضاً على تطوير نماذج الذكاء الاصطناعي الجديدة الأكثر كفاءة بسرعة هائلة، وقد تتمكن النماذج الجديدة من تجاوز أي إجراءات حماية جديدة.

يقول سلمان إن أفضل سيناريو هو أن توفّر الشركات التي تطوّر نماذج الذكاء الاصطناعي طرقاً لحماية الصور قابلة للتطبيق على نماذج الذكاء الاصطناعي المحدّثة جميعها.

يقول الخبير في الذكاء الاصطناعي التوليدي وتكنولوجيا التزييف العميق، هنري آيدر، إن تطوير شركات الذكاء الاصطناعي طرقاً لحماية الصور من أساليب التلاعب المعتمدة على الذكاء الاصطناعي هو خيار قابل للتطبيق أكثر من محاولة استخدام أساليب غير موثوقة لكشف التلاعب المعتمد على الذكاء الاصطناعي.

اقرأ أيضاً: نظام ذكاء اصطناعي يفيض خيالاً من أوبن إيه آي بدأ يتعلّم توليد الصور

يضيف آيدر قائلاً إنه "يجب على أي منصة للتواصل الاجتماعي أو شركة للذكاء الاصطناعي أن تفكّر في حماية المستخدمين من أن يقعوا ضحية إنشاء المواد الإباحية [من دون موافقتهم] أو أن تُستنسخ وجوههم لإنشاء المحتوى التشهيريّ".